東北地理所提出基于LLM與VLM融合重塑植物脅迫表型分析的AI新范式

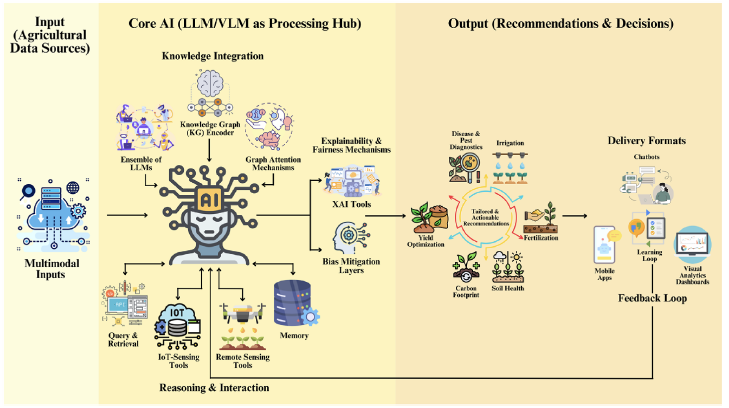

在全球氣候變化與糧食安全需求提升的雙重壓力驅動下,精準識別生物與非生物脅迫對作物影響的植物脅迫表型分析技術正經歷快速的技術變革。近期發表于《Plant Phenomics》的綜述,系統性闡釋了大語言模型(LLMs)與視覺-語言模型(VLMs)的融合應用,提出了一套新型研究框架,有望推動農業向規模化、精準化的智慧農業模式加速轉型。

傳統植物脅迫檢測方法高度依賴人工評估或單模態視覺模型,這類方法存在主觀性強、可擴展性有限的問題,且在復雜或復合脅迫場景下檢測性能不佳。與之相比,大語言模型與視覺模型的融合在作物脅迫檢測中展現出顯著優勢。盡管如此,這類系統仍存在模型幻覺、對數據集質量依賴性強、需針對特定領域進行提示詞工程設計或對視覺模型開展微調等局限性。

大語言模型與視覺-語言模型的協同融合,能夠實現對多模態數據的深度解析。視覺-語言模型融合圖像與文本編碼器,可聯合處理高分辨率作物影像與田間記錄,突破單視覺模型的泛化能力局限。同時,大語言模型憑借其在語義推理與少樣本學習方面的優勢,可完成文獻挖掘、性狀描述與標注、診斷報告生成等任務。檢索增強生成技術(RAG)的融入,進一步提升了結果的可靠性,緩解了模型幻覺問題。

盡管該技術具備巨大應用潛力,但其實際落地仍面臨諸多挑戰:高質量農業多模態數據集匱乏、模型訓練計算成本高昂、跨區域與跨語言的適配能力有限,且難以在復雜的田間環境中復現實驗室級別的檢測準確率。為解決上述問題,該綜述提出了一系列解決方案,包括利用生成對抗網絡(GANs)生成合成數據、優化輕量級模型架構、將知識圖譜(KGs)與神經符號推理相融合等。

作為該新興領域最早的綜合性綜述之一,本研究提出的大語言模型-視覺-語言模型融合框架,為抗逆作物育種與田間精準管理提供了跨學科研究新視角。隨著模型的持續優化與數據集的標準化建設,人工智能驅動的表型分析技術有望進一步突破“檢測-推理-決策”全流程的技術瓶頸,為可持續農業發展與全球糧食安全提供核心技術支撐。

中國科學院東北地理與農業生態研究所為論文第一完成單位,大豆分子設計育種重點實驗室ElshanMusazade特別研究助理為第一作者,馮獻忠研究員為通訊作者。研究得到生物育種國家科技重大專項(2023ZD040360301)和國家自然科學基金(U21A20215和32488102)的支持。

基于LLMs和VLMs的AI驅動植物脅迫管理框架

附件下載:

吉公網安備22017302000214號

吉公網安備22017302000214號